Twitter上有人點名首富Elon Musk,問他:「你會考慮建立一個新的社交媒體平台嗎?一個平台可以開放演算法原始碼,把言論自由和遵從言論自由的精神當成首要任務,以及把片面的政治宣傳降到最低的平台,我認為這種平台是我們迫切需要的。」而Elon Musk則回應,「認真考慮中!」

我相信,這幾個陳述是許多人所期待的社交平台要具備的要素。目前「演算法」是各家科技平台的最核心技術,也是最核心的機密,它決定了我們會看到怎麼樣的內容。如果開放演算法的原始碼,我們就有機會知道自己為什麼看到哪些文章、為什麼看不到另外的哪些東西。如果一個平台遵守「言論自由」的原則,那我們就可以盡情說話,不會莫名被審核發言甚至停權;如果平台可以把政治宣傳降到最低,那我們就看不到不喜歡的政治宣傳。

這三個要素是可能存在的嗎?讓我們來慢慢拆解。

演算法該公開原始碼嗎?利弊應該被權衡

第一個要素是,演算法應該公開原始碼。這些社交平台使用演算法,一開始是希望能夠過濾文章,進而讓使用者願意留下來。只是,透過訓練與學習的過程,演算法找到了留下使用者的好方法:利用人的弱點,只給使用者看他喜歡的內容。這引發了可得性偏誤,讓人誤以為自己看到的文章就是整個世界的面貌,或者是加強所謂同溫層效應,只要跟自己不合的意見,就持續忽略。很多人都認為,這樣的演算法應該被公開,讓大家自己選擇要不要使用。

演算法是許多平台的商業利益所在,因為它可以影響使用者看到的內容,讓付費的內容更容易被看見,因此平台確實有動機不公開演算法;不過,大方向上,我仍傾向公開演算法,畢竟公開演算法之後,大家才知道這些資訊為什麼被推到眼前,以及有哪些資訊被漏掉了,或是可以選擇自己喜歡的演算法。

不過,公開演算法還有其他風險,我認為應該要考慮進去。第一個風險,就是演算法的公開會導致內容農場經營者狙擊演算法漏洞,把他們的內容傳播得到處都是;可以想見,極權國家也可能會使用這些演算法的漏洞推播內容,用以影響民主國家的選舉。

從以前Google開始使用演算法過濾搜尋結果開始,內容農場與廣告商就一直在研究如何利用演算法來增加曝光。最早Google看的是關鍵字的露出次數,結果就出現一些不斷重複貼上關鍵字的網頁,出現整篇毫無意義、卻能在演算法中得到高分而被搜尋到的文章。也就是說,如果公開的演算法有漏洞,社交平台或搜尋引擎必然會遭到內容農場的狙擊,結果反而充滿著內容農場和廣告的內容。Google現在雖然會說明幾個重要的要素,但不會公開完整的演算法。

再者,很多人對於「公開演算法」的想像恐怕過於天真。最終判定哪些資訊該傳播,哪些該調降觸及的演算法是經過機器學習而成,而這些機器學習的材料,是平台上海量的資料。也就是說,單純只有最初的演算法原始碼而沒有資料,恐怕也無法得知最終演算法長什麼樣子,有時候甚至連平台自己都無法掌握。臉書就曾經弄錯演算法,導致假消息反而被推送出去。

而且,演算法的公開也有很多要討論的面相,比如,什麼情境該公開?該對誰公開,又該公開多少?一旦公開演算法後被惡意利用,但這個惡意利用可以讓平台獲利,請問平台該怎麼處理?若是平台選擇不作為,使用者有救濟的管道嗎?這些問題其實都需要被好好討論。

當然,演算法的公開也可以讓大眾來協力強化,但是大眾的協作與內容農場的狙擊,究竟何者會贏?就如同開放原始碼的程式若是有漏洞,可能被駭客利用入侵,也可能被其他開發者修正。因此,開放演算法後,究竟是哪一邊會贏,其實還是未定之天。不過,基於我個人對於開放原始碼的信念,我還是傾向認為,公開演算法原始碼並讓大家一起討論,或許是更能促進公眾一起來關心、協作的好方法。

遵守言論自由還有可能降低政治宣傳嗎?

第二個要素,「遵守言論自由」,應該跟第三個「把政治宣傳降到最低」放在一起看。事實上,這兩個要素是衝突的:有些言論,可能在一群人眼中應該受到言論自由的保障,卻有另外一群人認為是應該被降低觸及的政治宣傳。

為什麼會有這兩個衝突的陳述?我認為,這就是現在社群網路使用者的弔詭之處。大家在自己的言論遭到限制的時候,往往都會不滿;但同時卻看某些言論不順眼,希望這些言論不會再被看到。這其實就是所有的社交平台經營上都會遇到的核心問題:哪些言論是該被禁止的?哪些言論又該開放,中間又有哪些處置措施?

有些言論就應該被處理。

首先,言論自由並不代表發文後不用負責。所謂的保障言論自由,是指發文前沒有被審核,但言論一旦造成損害,當事人就應該負起相應責任,可能是因此被處罰,或甚至司法追訴。這並不是對言論自由的侵害,而是要求當事人對其發言負起責任。當然,如果有任何處罰,都應該符合比例原則,並應明確告知當事人該懲罰的理由與原因,並提供當事人適當的救濟管道。

絕不刪除言論的「無限制言論自由」是不可行的。在最極端的狀況下,兒童色情、不被當事人允許的性私密影像等,每一次被流傳,都是對當事人的傷害,我想多數人都同意,這樣的貼文一定要被刪除,以免廣傳後對當事人造成更大的傷害。並非所有言論都該被保障,一定要有下架的機制。還有,有些陰謀論若沒有妥善處理,也可能會在平台上流傳渲染,進而造成傷害,著名的Pizza Gate陰謀論就是一個例子。

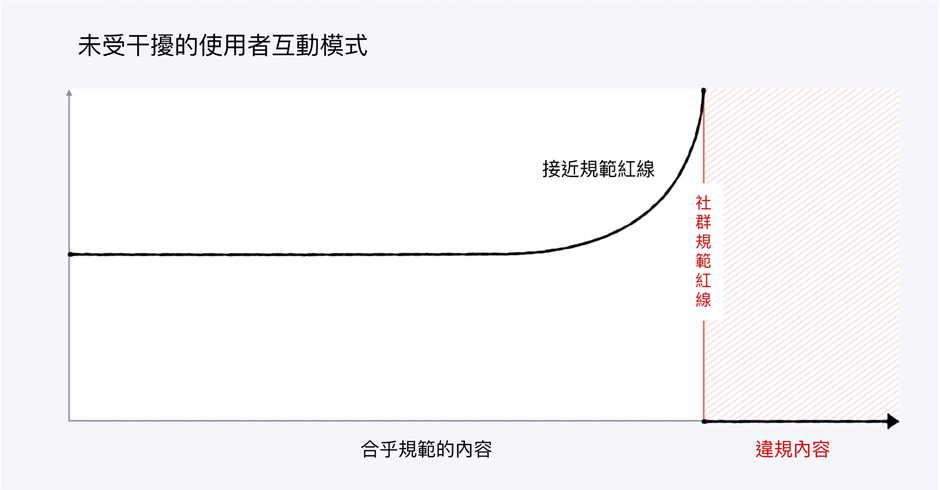

真實有極限,但謊言則無。許多文章之所以聳動,是因為內容有造假或極端的成份,使比事實陳述更為聳動,進而吸引更多人閱讀而受到演算法的青睞而廣傳。在《製造真相》一書第399頁引述FB執行長祖克柏貼文,在社交平台上,越極端、越聳動的文章,就越吸引人,越可能吸引人廣傳。如果不做任何處理,事實很難勝過極端聳動的言論,平台上就會充斥這些言論。

未受干擾的互動模式。圖片修改自Mark Zuckerberg臉書貼文,翻譯取自《製造真相》第399頁。

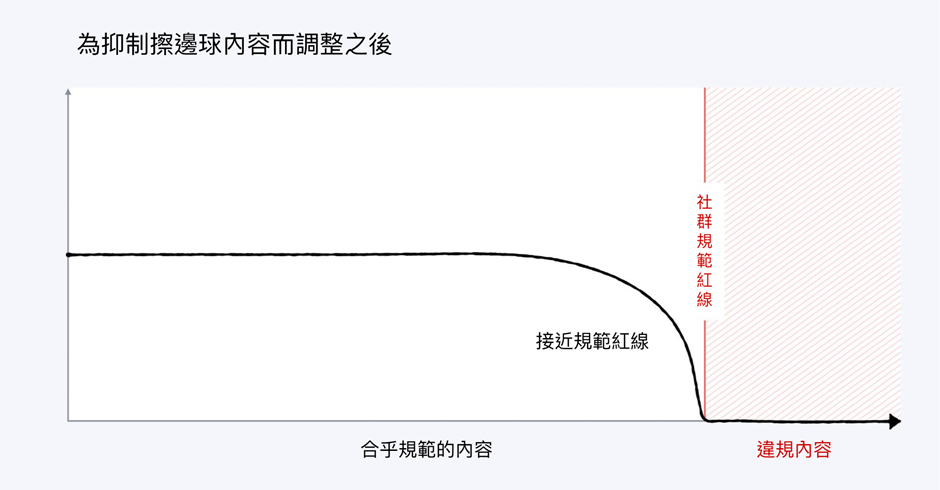

未受干擾的互動模式。圖片修改自Mark Zuckerberg臉書貼文,翻譯取自《製造真相》第399頁。 FB希望透過演算法達到的目標。圖片修改自Mark Zuckerberg臉書貼文,翻譯取自《製造真相》第399頁。

FB希望透過演算法達到的目標。圖片修改自Mark Zuckerberg臉書貼文,翻譯取自《製造真相》第399頁。FB演算法難以理解人類語言的模糊性

FB嘗試用演算法解決極端聳動文章比事實還要更吸引人的問題,理想上應該讓這些越極端的文章可以受到越多限制,雖然文章不會被刪除,但不會被演算法推播。這樣一來,就達到了前面提到的第二個與第三個要素:文章不會被刪除,但是政治宣傳掉到最低。

但是,FB的演算法看起來是有問題的嘗試。有許多人的文章被演算法判定違規而隱藏,引發不滿。這個問題有兩個層面,一個是平台的問題,另一個卻是使用者。在平台方面,由於無法即時審核所有的貼文,演算法看來確實是輔助少量人力審核貼文所需要的工具。問題在於,演算法是用什麼來學習?如果是有政治立場的審查人員(比如引入中國的審查人員),或是可以發動群眾檢舉文章的檢舉機制,演算法就可能學習到有問題的審核方式。另外,人的認知十分複雜,有些文章其實是反串或者反諷。演算法可以學習到這麼細緻的人腦機制嗎?看來很難。因此,演算法的介入,以及有問題的審核機制,常常會讓FB不當地下架其實並沒有問題的文章。

而且,演算法經過大量資料訓練後已經成為黑箱,這使FB很難具體說明該文被懲罰的原因為何。FB在處理這類問題上常常沒有告知具體的理由與原因,也沒有提供客觀第三方的審核與救濟管道,這使FB在處理這類議題上難以服眾,自然也引發了許多人的不滿。

言論被限制的使用者感到不滿

在使用者方面,這個機制有可能處理了該下架的文章,但是卻引發使用者的不滿。為什麼?因為這些內容當事人可能並不認為有問題──但文章確實有問題,比如可能鼓動了仇恨,或是查證不確實而可能有假消息的疑慮。在這種狀況下,發文者或支持該文的人就會感到不滿。如果加上前面的演算法,使用者原本就只會看到跟自己立場相近的文章,自然也只會看到接近己方的文章遭到下架,就會覺得社交平台方面有政治立場。

這樣的問題也出現在假消息的查核上。我相信大家都同意,如果訊息可能傳遞錯誤資訊,或是內容沒有查證、偽造,這樣的消息應該被處理。但是,如果遇到跟自己的立場接近,但是跟事實有些偏差,或是被加油添醋的文章被查核組織認定有造假成分,很多人就會感到生氣,進而認定查核組織有特定立場。但事實上,許多國際事實查核聯盟(International Fact-checking Network,IFCN)所認證的查核組織,會是針對各種立場都進行查核──只是有些立場的查核常常在社交平台上沒有被看到罷了。

由此觀之,許多人的不滿,簡單說起來,就是:我希望可以不受控制地說話,但我也希望看不到我不喜歡的政治宣傳(因為我喜歡的並不是政治宣傳)。大家可以想像,如果社交平台真的符合這樣的想法,那大概只有兩種可能:一種是變成一言堂,其他人都離開這個平台(或這個版面),另一種就是這個社交平台維持了各種同溫層,而觀點不同者彼此老死不相往來,大家在自己的同溫層中慢慢變得極端。

假帳號營造不存在的風向,卻難以處理

除了上面三個點以外,另外還有一個麻煩的議題:假帳號。許多民主的國家沒有網路實名制,因為實名制容易帶來對言論自由的箝制,但這也導致許多人會用假帳號來操作,比如透過按讚或假的互動,讓演算法誤判某些文章很重要,或是讓其他使用者誤以為這樣的論點有大量支持者。如PTT這個老牌BBS站上面的某些特定版面,若握有大量假帳號,就可以用推文推爆特定文章的方式來讓文章看起來比其他文章受歡迎。假帳號該如何追查與認證,是否應該刪除,還是降低其參與討論的權重?這是需要大家一起討論與思考的點。

重點不在言論自由,而是聆聽

如果真的希望社交平台能夠成為理性討論的地方,最大的重點其實不在言論自由,而在於聆聽,也就是真的讀懂、或了解對方的意思。要對話,就要先聆聽。如果大家都不願意聆聽,只想講話,那麼最終就會沒沒有對話而只有吵架。而對於所發出的文章或言論,當事人在享受言論自由的同時,也要對自己產生的內容負起責任。

社交平台要如何鼓勵聆聽?我自己覺得很困難。要聆聽就要願意放下我執,但在這個一切都加速進行的年代,少有人有時間、有餘裕放下自己的成見,讓別人的想法到心中滾一圈。不過,這並非沒不可能。人腦有兩種輸入資訊的機制,一種是用眼睛閱讀,另一種則是用耳朵聆聽。如果使用的視覺閱讀網路上的資訊,有時候相關資訊太多,不一定可以確實專注。但如果搭配聽覺,用聽的,有時候會有不一樣的效果。或許,使用不同的媒介吸收資訊,讓人們有機會靜下心來,就有機會促成更多聆聽與對話。

市場機制可以讓使用者對自己內容負責嗎?可能很難

至於對自己的言論負責,一個是針對有問題內容的處罰,另一個是針對好內容的獎勵。在針對有問題內容的處罰方面,除了社交平台上針對濫發假消息者會給予禁言等處分外,實體世界的司法機制也可以針對誹謗或是散佈不當內容等進行追訴。我也同意,應該透過法律的制定,去禁絕那些真的不該出現的內容,如兒童色情、性私密外洩影像等等。但畢竟總有言論處於灰色地帶,過往,媒體也曾出現大幅報導腥羶色內容以求更多人閱讀的狀況,但後來透過媒體自律,這樣的狀況得到了一定程度的改善。或許,我們也可以援引類似的精神,透過數位識讀素養的推動,幫助使用者在吸收資訊、轉發的時候,也能夠針對內容進行一定程度的把關與查證。

在獎勵方面,近期在Web3平台上,有人希望可以用「寫好文章就可以得到收入」的機制來鼓勵使用者發出好文章、好論述,進而營造好的討論環境。不過,這個機制該如何建立,其實是個大問題。在過往的雜誌、報紙,會有編輯把關,並以稿費獎勵使用者,是以人與中心化的方式進行處理。但如果要在平台上建立機制,該如何避免前述的假帳號洗評價?該如何避免極端與操弄情緒的文章更容易吸睛與引人注意?這個核心概念是希望用市場機制來鼓勵好內容產生,但問題是,市場喜好的文章不見得就有價值,而且市場有時候也會失靈。如果沒有看到這些可能的狀況,僅僅依賴對市場的信仰,將會是很可怕的一件事情。

換個方式講,Write2Earn的機制早在網路上出現,也就是透過內容農場的方式,讓寫手寫出吸睛但很可能造假的文章,吸引流量、得到廣告收入後再分潤給產生流量的寫手。這樣的機制已經被濫用,產出了許多傷害民眾健康的假保健文章,也有內容農場與極權國家勾結,試圖以文章影響民主國家人民的政治認知。用文章換取收入的模式,可以鼓勵好內容,但更容易拿來鼓勵「有流量的內容」,而後者就很容易成為內容農場的溫床。

進一步來談,其實Facebook等既有的平台早就是Read2Earn了,只是賺錢的不是寫文章的人,而是社交平台本身透過演算法把人留在平台上,進而獲取流量與廣告收益。在這個平台獲得收益的同時,代價卻是使用者的觀點在演算法影響下產生偏誤,進而造成社會的撕裂、民主的挑戰。社交平台正以民主作為外部代價,換取自己的收益。

從人出發,才能營造好平台

行文至此,大家應該會發現,社交平台的經營與規範,並非一開始所想的那麼簡單。而這背後複雜的原因,其實不在於數位技術,而在於人的本身。人腦有偏誤,面對海量資訊的時候,容易遇到許多問題;同時,人本來就是情緒與立場優先於理性的動物,「理性思辨」本質上就較為違背人性。這種狀況下,如果還期待「自由市場」可以達到想像中的美好環境,我想很可能是緣木求魚了。

回到Elon Musk近期所發的豪語,我認為他可能目前還不了解經營社交平台可能遇到的各種挑戰。社交平台就像池子一樣,這個水不能太混濁,但至清也會無魚;每次的調整,就像在池中加料,嘗試形成新的平衡。該如何拿捏分寸,是很大的挑戰。我想,隨著Elon Musk深入這個議題,他應該也會開始產生不一樣的想法吧。

面對社交平台的亂像,我們自己能做什麼?我想,最重要的就是,我們不能總是站在自己的角度來思考「社交平台該如何讓我滿意」,而應該反過來思考,有什麼機制可以幫助自己放下執著,去學習聆聽與對話?怎樣的機制,才能幫助自己在發言之前,能夠學習查證、看見不同的多元意見,進而對自己的言論負起責任?從這樣的問題意識出發,或許我們才有機會找到適合討論的社交平台。

(本文感謝陳方隅協助審閱)

没有评论:

发表评论